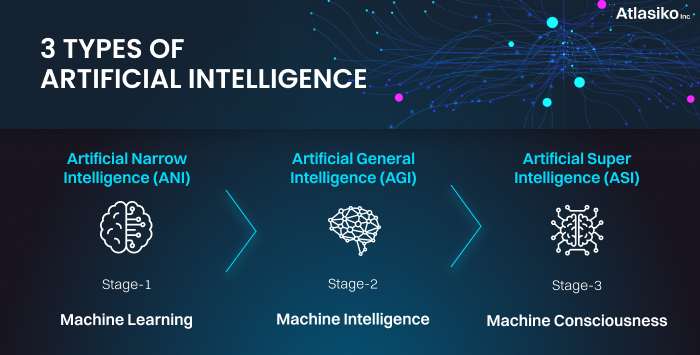

5G (20) 2022 (17) Agenda 2030 (11) AI (61) AI umělá inteligence (35) Artificial Intelligence (14) Biden (22) Bill Gates (16) CBDC (12) CDC (13) cenzura (32) CIA (32) Covid19 (244) Darpa (19) deep state (20) depopulace (20) Doporučuji ! (270) duše (11) elity (30) EU (20) fašismus (320) FED (13) FEMA (11) Gates (14) genocida (16) geoinženýring (14) geoinženýrství (12) Globalismus (404) globální elity (15) globální oteplování (25) google (21) Great Reset (26) HAARP (14) introspekce (17) Izrael (24) jaderná válka (16) Kanada (19) Klaus Schwab (13) Konspirace (25) korporace (16) krize (14) lež (16) mainstream (12) mRNA (24) Myšpule (14) média (18) nacismus (18) nanotechnologie (28) NASA (13) NATO (18) nový světový řád (13) NWO (338) Německo (14) obecná umělá inteligence (16) okultismus (22) OSN (39) ovládání mysli (14) oxid grafenu (20) očkování (197) pandemie (19) pentagon (11) Pfitzer (20) politika (11) propaganda (28) Putin (27) Rusko (77) satanismus (11) sebepoznání (12) smrt (15) speciální vojenská operace (11) svoboda (22) svoboda slova (11) světová vláda (13) technokracie (22) technologie (18) teror (11) total control (240) totalita (24) transhumanismus (138) Trump (18) tyranie (11) UFO (14) Ukrajina (53) Ukrajinská krize (11) umělá inteligence (41) USA (346) vakcíny (192) Velká Británie (22) Velký reset (11) video (11) vláda (22) vlády (12) Válka (59) vědomí (16) WEF (71) WHO (25) Země (11) změna klimatu (13) Čína (22) čína (11)