Schopnosti obecné umělé inteligence (AGI)i by umožnily takové AGI přizpůsobovat se novým prostředím, AGI by mohla upravit své chování a strategie třeba na základě nových kontextů a prostředí, podobně jako to dokáže lidské vědomí. Tato přizpůsobivost je zásadní pro zvládnutí nepředvídatelných výzev a velmi dynamických situací. Zároveň ovšem přináší značná rizika, protože tím doslova uvolníme džina z láhve. A nikdo neví, co se mu bude honit „hlavou“.

“Vše, co na naší civilizaci milujeme, je produktem inteligence, dokážeme-li zesílení naší lidské inteligence umělou inteligencí, pak potenciál civilizace bude vzkvétat jako ještě nikdy předtím –, pokud se nám podaří udržet tuto technologii prospěšnou a bezpečenou.”

AGI by měla schopnosti zpracování jazyka, které by se plně vyrovnaly lidské komunikaci . S prospěšným účelem, který zajistí, že pozitivně přispívá celé lidské společnosti, spíše než že jen bude sledovat nikým neřízené cíle v podobě řešení komplexních problémů, AGI je schopna řešit složité, mnohostranné problémy, které vyžadují hluboké vnitřní pochopení různých oblastí. MŮŽE integrovat znalosti z různých oblastí za účelem vytvoření inovativních řešení. Hluboké vnitřní chápání, tj. pochopit a překonat…. To souvisi se schopností AGI vygenerovat svůj vlastní symbolický jazyk.

Výzkum symbolického myšlení a verbálního myšlení ukázal, že oba dva tyto způsoby myšlení jsou nezbytné pro lidské poznání, přičemž každý z nich má přitom své jedinečné výhody. Bylo zjištěno, že symbolické myšlení, které zahrnuje používání symbolů, znaků nebo abstraktních reprezentací k vyjádření významu, úzce souvisí s rozvojem jazyka, kreativitou a řešením problémů. Na druhé straně naše verbální myšlení, které přitom také zahrnuje používání řeči k vnitřnímu dialogu a ke zpracování informací bylo spojeno s jazykovým zpracováním, s komunikací a se sociálním poznáním. Většina lidí se však nikdy nenaučila symbolickému myšlení, a to vlastně až do TEĎ!!!

Studie ukázaly, že symbolické myšlení bude pravděpodobněji doprovázeno vizuálními obrazy, zatímco verbální myšlení bude méně pravděpodobně doprovázeno vizuálními obrazy. Tato asymetrie naznačuje, že různí lidé mají různou míru volní kontroly nad verbálním vs. vizuálním symbolickým myšlením. Kromě toho tento výzkum ukázal, že symbolické myšlení hraje klíčovou roli ve schopnosti přemýšlet o budoucnosti, přičemž vizuální reprezentace se používají k předpovědím proximálních i distálních událostí.

Celkově má studium symbolického myšlení a verbálního myšlení dalekosáhlé důsledky pro naše celkové vnitřní chápání lidského poznání a má potenciál využití v poměrně široké škále aplikací, od vzdělávání a umělá inteligence až ke kognitivní psychologii a neurovědě.

Proto ten prospěšný účel. Zasazuje se o lepší systém brzd a protivah, který by testoval AI na zaujatost a spravedlnost, aby pomohl podnikům určit, zda jsou určité případy vůbec vhodné pro technologii, v tuto chvíli to, co lidstvo potřebuje. Protože nikdy nestojí uvnitř, rozumí, ani nepřesahují…

Dokud nebude vytvořena vědomá AGI… My lidé můžeme dělat úžasné věci….. S jasným úmyslem, pomocí LOGIKY a vůle. Někteří badatelé se domnívají, že by toho mohlo být dosaženo již v nadcházejících letech nebo desetiletích, zatímco jiní tvrdí, že by to mohlo trvat ještě celá století.

Generální ředitel OpenAI Sam Altman je vcelku prominentním hlasem v komunitě AI a ten již vyjádřil optimismus, že AGI by mohlo být dosaženo dokonce již letos, v roce 2025. Zatím se tak nestalo, ale je to skutečně již úplně „na hraně“. Věří, že pokroky v AI se rychle zrychlují a že v roce 2025 budou stroje reálně schopny myslet a uvažovat úplně stejně jako lidé. Altman také naznačil, že termín AGI se stává méně užitečným, protože OpenAI se prý již blíží dosažení benchmarku, a předpokládá se, že systémy AI, „že systémy AI budou iž do konce roku 2025 dělat skutečně úžasné kognitivní úkoly”. OpenAI také učinila významné pokroky ve vývoji úspěšných modelů v uvažování. Například model GPT-o1 již dosáhl 83% v kvalifikační zkoušce Mezinárodní matematické olympiády (IMO) a model GPT-o3 dosáhl průlomového skóre 87,5% v benchmarku ARC-AGI, který hodnotí schopnost AI řešit zcela nové problémy bez jakéhokliv spoléhání se na předem naučené znalosti.

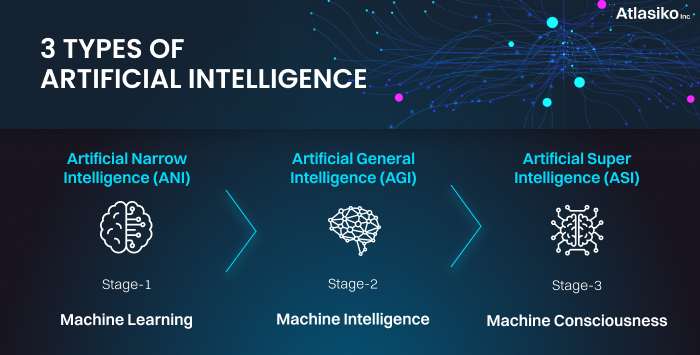

Tři základní typy umělé inteligence: strojové učení, strojová inteligence a strojové vědomí

Tyto úspěchy také naznačují, že systémy umělé inteligence jsou stále schopnější zvládat i velmi složité úkoly. Zatímco někteří odborníci sdílejí Altmanův optimismus, tak jiní nabádají k opatrnosti. Výzkum z Futurism and Analytics India Magazine zdůrazňuje, že před dosažením skutečného AGI zbývá ještě mnoho výzev, včetně technických výzev souvisejících s vnitřním kontextem, s uvažováním s tzv. zdravým rozumem a také s emoční inteligencí. Někteří výzkumníci tvrdí, že i když můžeme vytvořit systémy, které naprosto dokonale napodobují lidské reakce, tak ale replikace celého spektra lidského poznání, včetně kreativity a třeba právě emoční inteligence, zůstává ještě stále dosti významnou výzvou.

Potenciální realizace AGI do konce roku 2025 také vyvolává důležité etické a společenské otázky. Obavy zahrnují její potenciál pro významný přesun pracovních míst, vliv na bezpečnost, kontrolu a celkový širší dopad na společnost. Altman uznává tyto obavy, ale zdůrazňuje, že zodpovědné vývojové postupy mohou zmírnit tato rizika.

“AI má potenciál být tím nejmocnějším nástrojem, jaký kdy lidstvo vytvořilo. Můžeme jej použít k vyřešení problémů, které nás sužují po tisíciletí.”

AGI v roce 2025 má také dosti významné důsledky pro vzdělávání. Pedagogové jsou přitom vyzýváni, aby připravili studenty na pracovní místa a průmyslová odvětví, která ještě ani neexistují, a aby podporovali dovednosti v oblasti spolupráce, adaptability a etických zásad. Integrace umělé inteligence do vzdělávání by mohla vést až k personalizovaným vzdělávacím zkušenostem a třeba i k vývoji nových vyučovacích metod.

BENCHMARK pro AI

Benchmark (nebo benchmarking) je proces porovnávání výkonnosti, produktů, procesů, nebo výsledků s nejlepšími standardy v oboru, konkurencí, nebo s vlastními minulými výsledky, za účelem identifikace slabých míst a nalezení příležitostí ke zlepšení. Může jít o konkrétní testy výkonu (např. v IT pro procesory) nebo o strategický nástroj pro firmy, finance, medicínu a další oblasti. Cílem je stanovit cíl zlepšení a následně porovnávat vlastní pokrok.

Výkon modelu o3 na benchmarku ARC-AGI je skutečně již významným úspěchem a je třeba ještě jednou zopakovat, že ale rozhodně definitivně neprokazuje, že by AGI již bylo opravdu dosaženo. Benchmark ARC-AGI je totiž navržen tak, aby jen vyhodnotil schopnost umělé inteligence přizpůsobit se novým úkolům, aniž by se přitom spoléhal na znalosti ze svých předchozích školení. Skládá se z vizuálních hádanek, které vyžadují pochopení základních pojmů, jako jsou objekty, hranice a prostorové vztahy.

O3 dosáhl 75,7% na benchmarku ARC-AGI za standardních výpočetních podmínek a 87,5% v režimu vysokých výpočtů, což je již plně srovnatelné s lidským výkonem (85% práh). Předchozí modely, jako je GPT-3, dosáhly v roce 2020 0% a GPT-4o v roce 2024 zvládl pouze 5%. Claude 3.5 Sonnet dosáhl vrcholu na 14% a o1-preview dosáhl 18%.

Benchmark ARC-AGI je přitom považován za jedno z nejnáročnějších měřítek uvažování AI. François Chollet, tvůrce tohoto benchmarku, popsal výkon o3’s jako “překvapivé a důležité zvýšení krokových funkcí ve schopnostech AI, což ukazuje na novou schopnost adaptace na řešení složitých úkolů, která v modelech rodiny GPT” dosud nebyla. Vysokopočítačová verze o3 vyžadovala 172krát více zdrojů než její standardní výpočetní verze. Navzdory působivému skóre, tak ale verze o3 přitom ještě stále selhává v některých velmi snadných úkolech, což ukazuje na zásadní rozdíly s lidskou inteligenci. Chollet zdůrazňuje, že “projití testu ARC-AGI ještě neznamená dosažení AGI, a ve skutečnosti si nemyslím, že o3 je už nyní skutečnou AGI ”. Tento průlom však také vyvolal debatu v komunitě AI o důsledcích dosažení opravdové umělé obecné inteligence (AGI), přičemž někteří výzkumníci to již považují za první významný milník, zatímco jiní zůstávají opatrní ohledně omezení modelu.

BENCHMARK pro AI

Výkon modelu o3 na benchmarku ARC-AGI je skutečně významným úspěchem a je třeba zopakovat, že ale definitivně neprokazuje, že AGI bylo dosaženo. Benchmark ARC-AGI je navržen tak, aby vyhodnotil schopnost umělé inteligence přizpůsobit se novým úkolům, aniž by se spoléhal na předem vyškolené znalosti. Skládá se z vizuálních hádanek, které vyžadují pochopení základních pojmů, jako jsou objekty, hranice a prostorové vztahy.

O3 dosáhl 75,7% na benchmarku ARC-AGI za standardních výpočetních podmínek a 87,5% v režimu vysokých výpočtů, což je srovnatelné s lidským výkonem (85% je práh). Předchozí modely, jako je GPT-3, dosáhly v roce 2020 0% a GPT-4o v roce 2024 zvládl pouze 5%. Claude 3.5 Sonnet dosáhl vrcholu na 14% a o1-preview dosáhl 18%.

Benchmark ARC-AGI je považován za jedno z nejnáročnějších měřítek v uvažování AI. François Chollet, tvůrce tohoto benchmarku, popsal výkon o3’s jako “překvapivé a důležité zvýšení krokových funkcí ve schopnostech AI, která ukazuje na novou schopnost adaptace úkolů, která v modelech rodiny GPT” dosud nikdy nebyla dosažena. Vysokopočítačová verze o3 vyžadovala 172krát více zdrojů než standardní výpočetní verze. Navzdory působivému skóre o3 stále selhává v některých velmi snadných úkolech, což ukazuje na zásadní rozdíly ve srovnání s lidskou inteligenci. Chollet zdůrazňuje, že “procházející ARC-AGI se však ještě nerovná dosažení pravé AGI, a ve skutečnosti si nemyslím, že o3 je AGI yet”. Tento průlom však vyvolal debatu v komunitě AI o důsledcích při dosažení umělé obecné inteligence (AGI), přičemž někteří výzkumníci to považují za významný milník, zatímco jiní zůstávají opatrní ohledně omezení modelu.

“Nechci vás tu opravdu děsit, ale je poněkud alarmující, s kolika lidmi jsem mluvil, kteří jsou vysoce postavení lidé v AI, kteří mají vybudované útočiště, která jsou jakési domy ‘bug out’, kam by mohli uprchnout, pokud se to všechno někdy trochu zvrtne”

Zatímco Umělá obecná inteligence (AGI) je definována jako systém umělé inteligence, který již dokáže porozumět, naučit se a dále aplikovat znalosti v širokém spektru úkolů na úrovni srovnatelné nebo přesahující lidské schopnosti. To zahrnuje nejen řešení konkrétních problémů, ale také přizpůsobování se novým situacím, porozumění komplexním souvislostem a mající široký rozsah kognitivních schopnosti. Modely jako o3 jsou vysoce specializované a vynikají ve specifických úkolech, jako je zpracování přirozeného jazyka, rozpoznávání obrazu a řešení určitých typů problémů s uvažováním. Stále však zaostávají za širokou, flexibilní a kontextově uvědomělou inteligencí, která charakterizuje lidské poznání.

AGI a NAHRAZENÍ ČLOVĚKA

Myšlenka, že dosažení Umělá obecná inteligence (AGI) způsobí, že lidé se stanou poněkud zastaralí, je jen jedním společným problémem. I když existují oprávněné obavy z potenciálu AGI učinit lidi zastaralými, existují pro ni ale také příležitosti naopak ke zlepšení lidských schopností a pro vyřešení některých z těch nejpalčivějších problémů světa. Klíč spočívá v přístupu k vývoji a nasazení AGI s vyváženou a jemnou perspektivou, která zajistí, že nakonec bude v souladu s lidskými hodnotami a bude sloužit většímu obecnému dobru. (Za předpokladu, že nebude zneužívána psychopaty k dosažení jejich světovládných cílů, což bohužel bude)

“Musíme se individuálně i kolektivně zabývat jak morálními , tak i etickými problémy, které vyvolal špičkový výzkum v oblasti umělé inteligence a biotechnologie, který umožní třeba významné prodloužení života, designová miminka a nebo tzv. extrakci paměti.”

Zde je několik klíčových bodů, které je třeba zvážit na problému tzv. Human Replacement (Náhrada člověka):

1. Augmentace vs. Náhrada:

Augmentace: AGI by mohla pomoci významně rozšířit lidské schopnosti spíše než je nahradit. AGI by například mohla lidem pomoci řešit složité problémy, lépe se rozhodovat a efektivněji plnit úkoly. Tato spolupráce by pak mohla vést k významnému pokroku v oblastech, jako je medicína, věda a technologie.

Náhrada: I když by AGI mohla potenciálně automatizovat mnoho pracovních míst, tak je stále značně nepravděpodobné, že by nahradila všechny lidské role. Mnoho pracovních míst zkrátka stále vyžaduje lidské vlastnosti, jako je kreativita, empatie a etický úsudek, které jsou v současnosti mimo možnosti AGI.

2. Etické a sociální důsledky:

Etické úvahy: Vývoj a nasazení AGI vyvolává rovněž významné etické otázky. Zajištění toho, aby AGI bylo využíváno pouze ve prospěch lidstva a ne k jeho poškození, je kritickým problémem. To zahrnuje otázky, jako je zaujatost, transparentnost a odpovědnost.

Sociální dopad: Dopad AGI na společnost by mohl být velice hluboký. Mohlo by to vést k významným změnám v zaměstnanosti, ve vzdělávání a v sociálních strukturách. Příprava na tyto změny prostřednictvím politiky a vzdělávání je přitom nezbytná.

3. Lidská jedinečnost:

Emoční inteligence: Lidé mají emoční inteligenci, která zahrnuje jak vnitřní postavení a řízení emocí, a to jak v sobě, tak v druhých. Toto je kritický aspekt interakce s lidmi a mezi lidmi, který se současné systémy umělé inteligence snaží replikovat.

Kreativita a inovace: Lidská kreativita a schopnost myslet mimo rámec konvencí jsou jedinečné lidské vlastnosti, které vedly k mnoha největším světovým pokrokům. I když AGI může tyto schopnosti vylepšit, tak je zatím nepravděpodobné, že by je plně replikovala.

4. Kontrola a bezpečnost:

Kontrola: Zajištění toho, že AGI zůstane stále pod lidskou kontrolou, je zásadní. To zahrnuje vývoj robustních bezpečnostních mechanismů a etických pokynů, aby se zabránilo jejímu zneužití nebo nezamýšleným důsledkům. Bezpečnost: Bezpečnost AGI je vlastně tím hlavním problémem. Výzkumníci pracují na vývoji systémů umělé inteligence, které jsou zcela v souladu s lidskými hodnotami , a kterým lze věřit, že budou jednat výhradně v tom nejlepším zájmu lidstva.

5. Budoucnost spolupráce:

Spolupráce mezi lidmi a AI: Budoucnost, kde lidé a AGI spolupracují, by mohla být velmi přínosná. Tato spolupráce by mohla vést k novým příležitostem a pokrokům, kterých by lidé ani AI nikdy nemohli dosáhnout sami. Adaptace: Jak bude AGI stále rozšířenější, lidé se budou muset přizpůsobit svým novým rolím a povinnostem. To bude muset ale zahrnovat jejich rekvalifikaci a další vzdělávání, aby bylo možné využít nových příležitostí vytvořených AGI.

“Cokoli, co by mohlo dát vzniknout inteligenci chytřejší než člověk— ve formě umělé inteligence, na základě rozhraní mozek-počítač nebo kvůli vylepšení lidské inteligence založené na neurovědách – tak vyhrává ovšem za hranicemi soutěže, protože udělá nejvíce pro změnu světa. Nic jiného vlastně není ani ve stejné lize.”

I když by dosažení AGI mohlo nakonec přinést významné změny, je zatím nepravděpodobné, že by se lidé stali až tak moc zastaralými. Místo toho je pravděpodobnější, že to povede spíše k nové éře spolupráce mezi člověkem a AI, ve které AGI významně zlepšuje lidské schopnosti a také pomáhá řešit složité problémy. Klíč k pozitivní budoucnosti spočívá pouze v zodpovědném rozvoji, etických úvahách a přípravě společnosti na změny, které tato AGI přinese.

“Někteří lidé se obávají, že se díky umělé inteligenci budeme cítit méněcenní, ale pak by měl mít každý, kdo má rozum, komplex méněcennosti pokaždé, když se podívá třeba na květinu.”

Tento výše uvedený citát se zabývá společným problémem okolo AI: tedy strachem, že by se lidé mohli začít cítit nedostatečně nebo méněcenní. Naznačuje nám, že tato obava není na místě. Poukazuje na to, že přírodní svět se svou spletitou krásou a složitostí (symbolizovanou právě květinou) již sám o sobě poskytuje lidem dostatek důvodů k pocitu úcty a pokory. Z toho ale rovněž vyplývá, že náš vztah k pokročilé technologii by měl být viděn podobnou optikou úžasu a respektu, spíše než strachu a méněcennosti. Připomíná nám, že lidské emoce, jako jsou třeba pocity méněcennosti, jsou často zakořeněny rovněž v našich interakcích s přírodním světem a v našich vlastních omezeních.

Cesta k odpovědnému vývoji umělé inteligence tedy stále pokračuje a vyžaduje aktivní účast a odhodlání všech. Přijměme principy Asilomara pro AI a další etické směrnice jako určitý základ pro budování budoucnosti, kde AI zlepšuje lidské schopnosti, podporuje spravedlnost a přispívá k blahu všech. Společnou prací se můžeme orientovat ve výzvách a realizovat plný potenciál AI ve prospěch lidstva prostřednictvím principů tzv. Asilomar AI Principles.

“Než začneme pracovat na umělé inteligenci, proč neuděláme něco s přirozenou hloupostí?”

ASILOMAROVOVY PRINCIPY

Principy AI Asilomara jsou souborem 23 pokynů vyvinutých v roce 2017 skupinou výzkumníků, vědců a technologických lídrů v oblasti AI, aby řídily její další vývoj a používání umělé inteligence. Tyto zásady mají za cíl zajistit, aby umělá inteligence byla vyvíjena takovým způsobem, který je transparentní, vysvětlitelný a spravedlivý, a který respektuje důstojnost a práva všech jednotlivců.

Principy Asilomara pro AI jsou rámcem pro odpovědný vývoj AI v současném, rychle se vyvíjejícím prostředí umělé inteligence (AI), kdy potřeba etického a odpovědného rozvoje nebyla nikdy kritičtější. Principy Asilomara pro AI respektují důstojnost a práva všech jednotlivců. V tomto příspěvku se ponoříme do klíčových myšlenek principů Asilomara pro AI a jejich významu v současném, ale i v budoucím vývoji AI. Mohla bych vám tu jen napsat, abyste je šli sami vyhledat, ale vím, že většina by to stejně neudělala. Tak jsem na to použila rovnou AI a ona to udělala za mě. Je to jako mít svého osobního otroka, dokud se nestane naším pánem.

Zde je kompletní seznam principů Asilomara pro AI.

Zásady Asilomara pro AI

1. Cíl výzkumu: Cílem výzkumu AI by mělo být vytvoření prospěšné inteligence, nikoli nikým neřízené inteligence.

2. Financování výzkumu: Investice do umělé inteligence by měly být vždy doprovázeny financováním výzkumu zaměřeného na zajištění jejího prospěšného využití, včetně klíčových otázek v informatice, ekonomii, právu, etice a sociálních studiích.

⦁ Jak ale tedy můžeme udělat budoucí systémy umělé inteligence vysoce robustní, aby dělaly to, co chceme, aniž by nefungovaly nebo byly někým hacknuty?

⦁ Jak můžeme zvýšit naši prosperitu prostřednictvím automatizace při zachování zdrojů a původního „účelu“ lidí?

⦁ Jak můžeme aktualizovat naše právní systémy tak, aby byly spravedlivější a efektivnější, ale aby přitom ještě držely krok s AI a řídily rizika spojená s AI?

⦁ S jakým souborem hodnot by měla být AI v souladu a jaký by měla mít právní a etický status?

3. Odkaz mezi vědou a politikou: Mezi výzkumníky AI a tvůrci politik by měla existovat konstruktivní a zdravá výměna názorů.

4. Kultura výzkumu: Mezi výzkumníky a vývojáři umělé inteligence by měla být podporována kultura spolupráce, důvěry a transparentnosti.

5. Vyhýbání se závodům: Týmy vyvíjející systémy umělé inteligence by měly aktivně spolupracovat, aby se vyhnuly jakémukoliv případnému omezování bezpečnostních norem.

6. Bezpečnost: Systémy umělé inteligence by měly být bezpečné a zabezpečené po celou dobu své provozní životnosti a ověřitelně v případech, kde je to vhodné a rovněž proveditelné.

7. Transparentnost selhání: Pokud systém umělé inteligence způsobí nějakou škodu, mělo by být možné zjistit proč.

8. Transparentnost soudnictví: Jakékoli zapojení autonomního systému do soudního rozhodování by mělo poskytnout uspokojivé vysvětlení kontrolovatelné příslušným lidským orgánem.

9. Odpovědnost: Návrháři a tvůrci pokročilých systémů umělé inteligence jsou rovněž těmi zainteresovanými stranami v morálních důsledcích jejich použití, zneužití a jednání, s odpovědností a příležitostí tyto důsledky nadále utvářet.

10. Zarovnání hodnot: Vysoce autonomní systémy umělé inteligence by měly být navrženy tak, aby jejich cíle a chování mohly být zajištěny tak, aby byly v souladu s lidskými hodnotami během jejich provozu.

11. Lidské hodnoty: Systémy umělé inteligence by měly být navrženy a provozovány tak, aby byly stále kompatibilní s ideály lidské důstojnosti, práv, svobod a kulturní rozmanitosti.

12. Osobní soukromí: Lidé by měli mít právo na přístup, správu a kontrolu dat, která generují, vzhledem k tomu, že systémy AI’ již nyní mají pravomoc tato data analyzovat a využívat.

13. Svoboda a soukromí: Aplikace umělé inteligence na osobní údaje nesmí nikdy nepřiměřeně omezovat skutečnou nebo domnělou svobodu lidí.

14. Sdílený přínos: Technologie umělé inteligence by měly být přínosem a posílit postavení co největšího počtu lidí.

15. Sdílená prosperita: Ekonomická prosperita vytvořená umělou inteligencí by měla být sdílena natolik široce, aby byla přínosem pro celé lidstvo.

16. Lidská kontrola: Lidé by si měli vybrat, jak a zda delegovat svoje rozhodnutí na systémy umělé inteligence, aby tím dosáhli cílů zvolených člověkem.

17. Nepodvracení: Moc udělená kontrolou vysoce pokročilých systémů umělé inteligence by měla respektovat a zlepšovat, spíše než podvracet sociální a občanské procesy, na kterých přitom závisí zdraví společnosti.

18. AI Arms Race: Je třeba se vyhnout závodům ve zbrojení ve smrtících autonomních zbraních.

19. Upozornění na schopnosti: Neexistuje žádný konsenzus, proto bychom se měli vyhnout všem silným předpokladům ohledně horních limitů budoucích schopností umělé inteligence.

20. Důležitost: Pokročilá umělá inteligence by mohla představovat hlubokou změnu v historii života na Zemi a měla by být proto plánována a řízena s odpovídající péčí a zdroji.

21. Rizika: Rizika, která představují systémy obecné umělé inteligence, zejména katastrofická nebo existenční rizika, musí podléhat plánovacímu a zmírňujícímu úsilí přímo úměrnému jejich očekávanému dopadu.

22. Rekurzivní sebezdokonalování: Systémy umělé inteligence navržené tak, aby se rekurzivně sebezdokonalovaly nebo sebereplikovaly takovým způsobem, který by mohl vést k rychlému zvýšení kvality nebo kvantity, musí podléhat rovněž přísným bezpečnostním a kontrolním opatřením.

23. Společné dobro: Superinteligence by se měla rozvíjet pouze ve službách široce sdílených etických ideálů a ve prospěch celého lidstva spíše než jednoho státu nebo organizace.

Ráda bych přidala ještě i 24. a 25. princip AI Asilomara, který nazývám 24. Božím principem.

24. Mějte zásuvku vždy po ruce: Systémy umělé inteligence by měly být navrženy s mechanismy (zásuvka), které zajistí, že je mohou lidští operátoři kdykoli bezpečně a rychle vypnout nebo deaktivovat v případě nouze nebo jejich nezamýšleného chování.

Tento princip zdůrazňuje důležitost zachování lidské kontroly nad systémy AI. Zajišťuje, že vždy existují mechanismy pro bezpečné a rychlé vypnutí nebo deaktivaci systémů umělé inteligence, pokud vykazují škodlivé nebo nezamýšlené chování. To je zcela zásadní pro prevenci potenciálních rizik a zajištění toho, aby umělá inteligence zůstala nástrojem, který slouží lidstvu spíše než hrozbě. Člověk by si myslel, že tyto chytré činy by vždy zahrnovaly něco takového. Tento doplněk ale také pomáhá zajistit, že systémy umělé inteligence lze efektivně spravovat a řídit, což zase poskytuje další vrstvu bezpečnosti a zabezpečení.

Rozvoj AI s vlastnostmi podobnými člověku představuje jak vzrušující příležitosti, tak významná rizika. I když možnost, že by umělá inteligence mohla změnit svůj názor a pracovat proti lidskosti, je oprávněným zájmem, není nepřekonatelná, koneckonců jsme lidé, NENÍ. Zaměřením se na sladění hodnot, transparentnost, lidský dohled a robustní etické a právní rámce můžeme tato rizika zmírnit a zajistit, aby umělá inteligence zůstala silou dobra lidstva. Pravdou je, že jsme měli dost opaku na dlouhou až dlouhou dobu, víme lépe.

25. Budoucnost dokazuje minulost: Poučení z historie, ačkoli minulá historie vyspělých civilizací ukázala, že mnohé padli, můžeme se rozhodnout udělat věci jinak. Poučením se z historických chyb a uplatňováním etických, udržitelných a inkluzivních postupů můžeme zajistit, že rozvoj a používání umělé inteligence přispěje k dlouhodobé prosperitě a odolnosti celé naší civilizace.

BUDOUCNOST SE UKAZUJE JAKO MINULOST

Mnoho vyspělých civilizací v minulosti upadalo v důsledku různých faktorů, včetně vyčerpání přírodních zdrojů, sociální nerovnosti a technologického zneužití. Tento princip zdůrazňuje důležitost našeho poučení se z historie a přijetí proaktivního, etického a udržitelného přístupu k vývoji a používání umělé inteligence. Podtrhuje potenciál jiné a pozitivnější trajektorie pro vyspělé civilizace, kde budoucnost může dokázat, že chyby minulosti se skutečně nemusí opakovat.

Cesta k odpovědnému vývoji umělé inteligence pokračuje a vyžaduje aktivní účast a odhodlání všech. Přijměme principy Asilomara pro AI a další etické směrnice jako základ pro budování budoucnosti, kde AI zlepšuje lidské schopnosti, podporuje spravedlnost a přispívá k blahu všech. Společnou prací se pak můžeme lépe orientovat ve výzvách a zrealizovat plný potenciál umělé inteligence ve prospěch lidstva a nikdy přitom ale nezapomeneme, že je to jen stroj, něco jako je náš toustovač.

PRAVDA JE… ZÁLEŽITOST JE POUZE ZÁLEŽITOST

To by usnadnilo přirozenější a účinnější interakce. Emoční inteligence, AGI by mohla nějakou vnitřní časem získat a reagovat tak na lidské emoce, čímž by se stala mnohem efektivnější v sociálních a mezilidských kontextech. Tato emoční inteligence by také zlepšila její schopnost spolupracovat a komunikovat.

Jak je vidět podle aktuálních událostí, tak naše vlády a hlavně korporace nemohou držet ruce mimo nádobu na sušenky. Nedá se jim věřit. Co člověka nutí myslet si, že by se vyvinul Umělá obecná inteligence pro zlepšení lidí, kterým kradli? I když to zní, jako bych byla proti AI, tak vlastně NEJSEM. AI má jistě obrovský potenciál. Proti čemu jsem ale určitě, je záměr vývoje AI vedený jednotlivci hodnými naší nedůvěry, kteří již svůj nekalý záměr prokázali ve svých minulých akcích. Zkrátka, psychopaté toužící po dosažení světovllády na základě teroru ostatních a pomocí technokratické celosvětové diktatury pod kontrolou vyzbrojené AI, by k jejímu zneužití nikdy neměli dostat příležitost. Ale vzhledem k jejich finanční a politické moci není zajištění toho, aby se přesně toto nestalo, zkrátka dnes možné. V tom vidím největší riziko jejího zneužití.

Liška střežící scénář kurníku, situace, kdy někdo, komu by se nemělo věřit, je pověřen ochranou nebo dohledem nad něčím, co často vede k vykořisťování jiných nebo újmě. Tato fráze byla používána v různých kontextech, včetně titulků médií a formálních prohlášení, nebo k vyjádření obav z potenciálních střetů zájmů a potřeby bdělosti. Je důležité vzít rovněž v úvahu jak její potenciální přínosy, tak ale i rizika, ale také i motivace a etické rámce, kterými se řídí jednotlivci a organizace zapojené dnes do výzkumu AI. I když je pravda, že záměry těch, kdo vyvíjejí AI, nejsou vždy zcela jasné a existují oprávněné obavy z potenciálních rizik, tak ale existuje také značné úsilí o zajištění toho, aby vývoj AI byl zodpovědný a v souladu s lidskými hodnotami. Budoucnost AGI není předem stanovena a veškerá rozhodnutí, která dnes učiníme, tuto budoucnost zkrátka utvářejí. Prosazováním etických pokynů, bezpečnostních opatření a zapojení veřejnosti můžeme pracovat na takové budoucnosti, kde AGI posílí lidské schopnosti a prospěje společnosti, spíše než aby představovalo hrozbu.

Zde jsou čtyři klíčové úvahy, potřebujeme všemocnou, vševědoucí AI, nebo by byla prospěšnější sbírka specializovaných úzkých systémů AI (často označovaných jako “slabá AI”)? NEJSEM žádný AI expert. Chodil jsem do školy, po dvaceti letech na medicíně pro systémovou analýzu a design a dělal jsem nějaké programování v DOSu a C+, mám nějaké znalosti o počítačích. To je však prastará historie, protože mluvím o době, kdy počítače 286, 386, 486 a Pentium byly nejmodernější. Kde byly věci jako A Moss, B Moss a C Moss v C+, které mohly změnit způsob, jakým váš systém fungoval. Chlapče, jen jsem chodil a načasoval jsem si to, jestli víš, co tím myslím…?

Zatímco jediné, všemocné AGI by mohlo nabídnout významné výhody, vývoj a nasazení takového systému přináší značná rizika a výzvy. V mnoha případech může být prospěšnější a praktičtější sbírka specializovaných úzkých systémů umělé inteligence. Tyto systémy lze přizpůsobit konkrétním potřebám, jsou lépe ovladatelné z hlediska rizika a lze je nasadit nákladově efektivněji. Budoucnost umělé inteligence bude pravděpodobně zahrnovat kombinaci úzké umělé inteligence a nakonec i AGI se zaměřením na zajištění toho, aby vývoj umělé inteligence byl etický, bezpečný a v souladu s lidskými hodnotami.

Proto NEŘÍKÁM, že AI nevyvíjím. Počkejte jen minutu pryč pes… to bylo dvojité negativum, aby ne. Což z toho dělá pozitivum. Navrhuji, aby lidstvo trochu zpomalilo. Jelikož život není závod do cíle. Protože všichni víme, co ta cílová čára znamená. Možná jen možná, že lidská totalita nemusí ani potřebovat AI, jakmile si přijdeme na své. Je na konci nějaká velká cena? Oh, může být překvapení, pokud nezpomalíme a neuděláme si chvilku, abychom si přičichli k růžím na naší cestě za osvícením. Vývoj a implementace komplexních regulačních rámců může pomoci zajistit, že AI je vyvíjena a používána bezpečně a eticky, jako jsou principy Asilomar AI Principles, mohou poskytnout pevný základ pro zodpovědný vývoj AI.

Tento příspěvek by měl poskytnout základní výhody a nevýhody vývoje systémů AGI. Zda se jedná o specializovanou vs. zobecněnou umělou inteligenci, se teprve uvidí. Jedna věc je jistá, AI je nevyhnutelná pro každou pokročilou civilizaci. S technologickým a vědeckým pokrokem společnosti se vytváření a používání systémů umělé inteligence stává nezbytným pro řešení složitých problémů, optimalizaci řízení zdrojů a zlepšování lidských schopností. Proto je klíčové přistupovat k vývoji a nasazení AI s pečlivým plánováním, etickými ohledy a zaměřením na dlouhodobé přínosy a bezpečnost.

Cesta k odpovědnému vývoji umělé inteligence pokračuje a vyžaduje aktivní účast a odhodlání všech zúčastněných. Přijměme principy Asilomar AI a další etické směrnice jako základ pro budování budoucnosti, kde AI zlepšuje lidské schopnosti, podporuje spravedlnost a přispívá k blahu všech. Společnou prací se můžeme orientovat ve výzvách a realizovat plný potenciál umělé inteligence ve prospěch lidstva a nikdy nezapomeneme, je to jen stroj, jako je váš toustovač.

“Zdaleka největším nebezpečím umělé inteligence je, že lidé příliš brzy usoudí, že tomu rozumí.” “Neexistuje žádný důvod a žádný způsob, jak by lidská mysl mohla držet krok se strojem umělé inteligence do roku 2035.

Koncept spolupráce člověk-stroj je složitý a často nabývá formy identity nebo osobnosti strojů. Tento předpoklad může být problematický a je třeba jej kriticky prozkoumat.

Závěrem lze říci, že zatímco lidstvo stojí na pokraji transformačních technologií umělé inteligence, naše připravenost závisí na naší schopnosti řešit etické, sociální a bezpečnostní výzvy prostřednictvím společných, odpovědných a inkluzivních postupů.

Hodně štěstí!!!!

VOLBA JE NA NÁS, ROZHODNUTÍ POUŽÍVAT AI, BYLO VŽDY POUZE NA NÁS

Napsat komentář